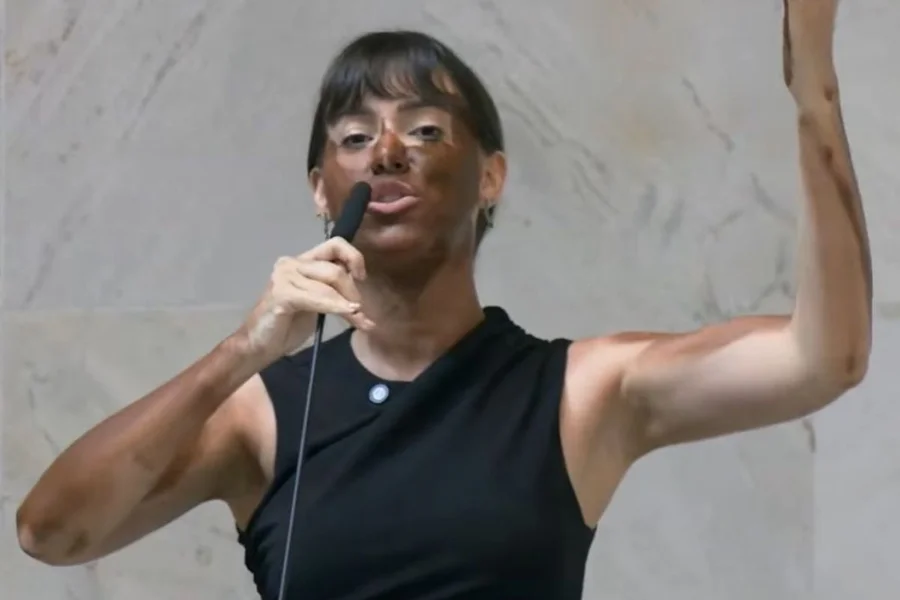

Ferramentas de inteligência artificial capazes de clonar vozes com poucos segundos de áudio já estão sendo usadas em golpes financeiros. O alerta foi feito pelo especialista em IA Giovanni La Porta, CEO da vortice.ai, durante entrevista ao Podcast Canaltech.

Segundo ele, um dos métodos mais preocupantes envolve ligações silenciosas, em que o criminoso aguarda a vítima falar para capturar o áudio. “Quanto mais você responder aquela ligação e continuar falando, mais perfeita ficará a clonagem da sua voz”, explicou. Depois, os golpistas utilizam o material para enviar áudios por aplicativos como WhatsApp, simulando familiares ou conhecidos e pedindo transferências.

O especialista também destacou que a tecnologia já permite criar deepfakes convincentes, inclusive em reuniões corporativas. Para identificar possíveis fraudes, ele recomenda observar inconsistências em vídeos, especialmente quando a pessoa vira o rosto. Segundo La Porta, o uso da tecnologia não é crime por si só, mas pode se tornar ilegal dependendo da finalidade.